Wie man IPv4-Adressen fur KI-Infrastruktur kauft

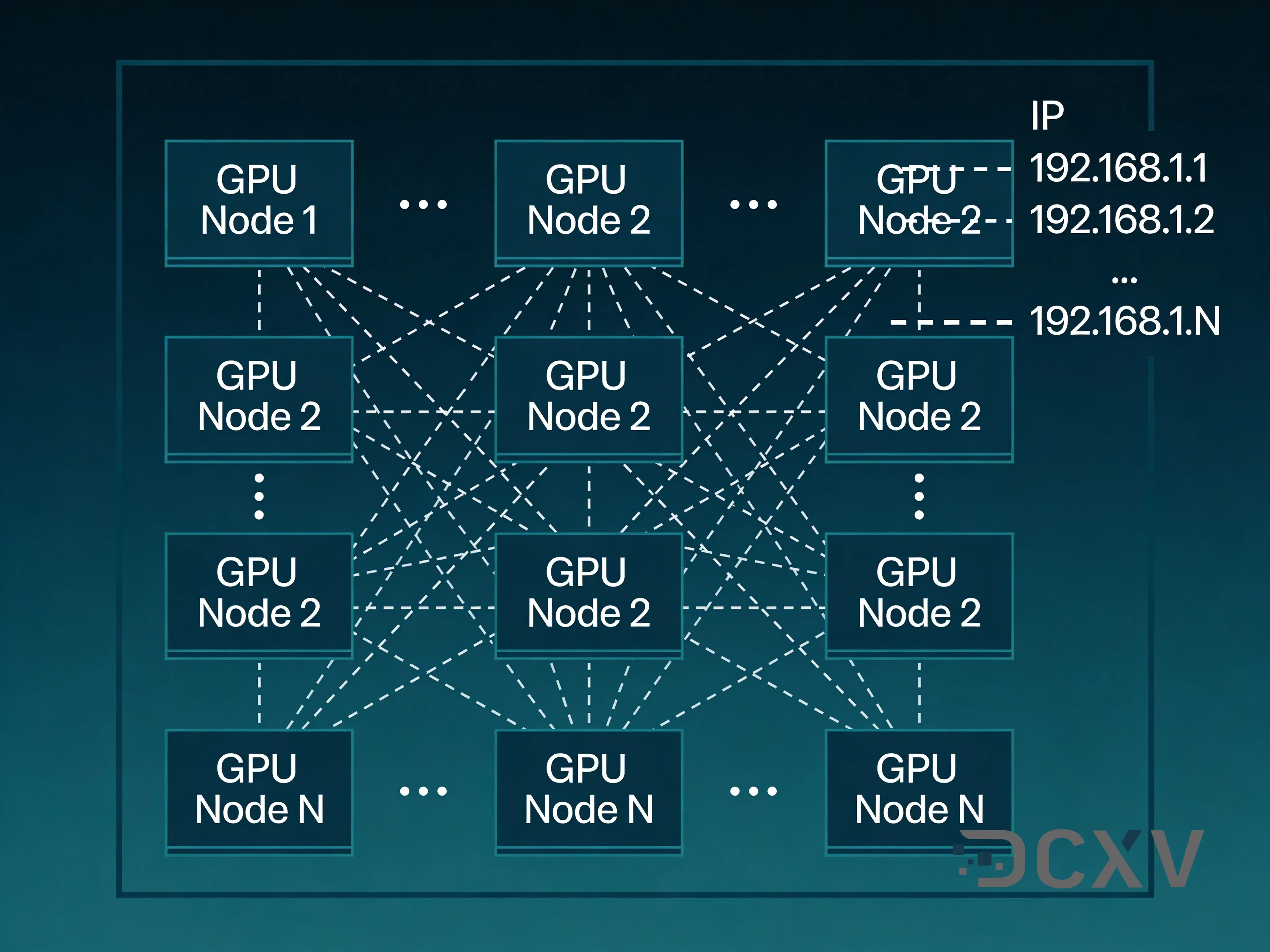

KI-Infrastruktur hat im Vergleich zum traditionellen Hosting unterschiedliche IPv4-Anforderungen. GPU-Cluster, Inferenz-Endpunkte, Modell-APIs und verteilte Trainingsworkloads haben jeweils unterschiedliche Adressierungsmuster.

Wie viele IPs benotigt KI-Infrastruktur typischerweise (Blockgrossenguide)

Fur einen kleinen bis mittleren Inferenz-Cluster (8-64 GPUs) ist ein /24 (256 Adressen) fur Management, Monitoring und API-Exposition in der Regel ausreichend. Multi-Tenant-GPU-Clouds benotigen oft /22- oder /21-Blocke.

RIPE vs ARIN vs APNIC - aus welcher Region kaufen

Fur KI-Infrastruktur in Europa ist RIPE-Adressraum die naturliche Wahl. Europaische KI-Regulierungen begunstigten zunehmend EU-basierte Infrastruktur mit EU-Adressierung.

Wie man einen sauberen IPv4-Block verifiziert

Prufen Sie alle Kandidatenblocks gegen Spamhaus SBL, XBL, PBL und AbuseIPDB. Saubere IP-Reputation ist fur KI-Infrastruktur besonders wichtig.

Broker vs. Direktubertragung

DCXV ist zugelassener Broker bei RIPE NCC, APNIC und ARIN. Kontaktieren Sie uns unter ipv4@dcxv.com. https://dcxv.com/ipv4

Aktuelle Marktpreise und Zeitrahmen

Fur aktuelle Preisangaben kontaktieren Sie ipv4@dcxv.com. https://dcxv.com/ipv4